NotebookLM : la méthode pro que 90% d’utilisateurs ignorent ?

Définition

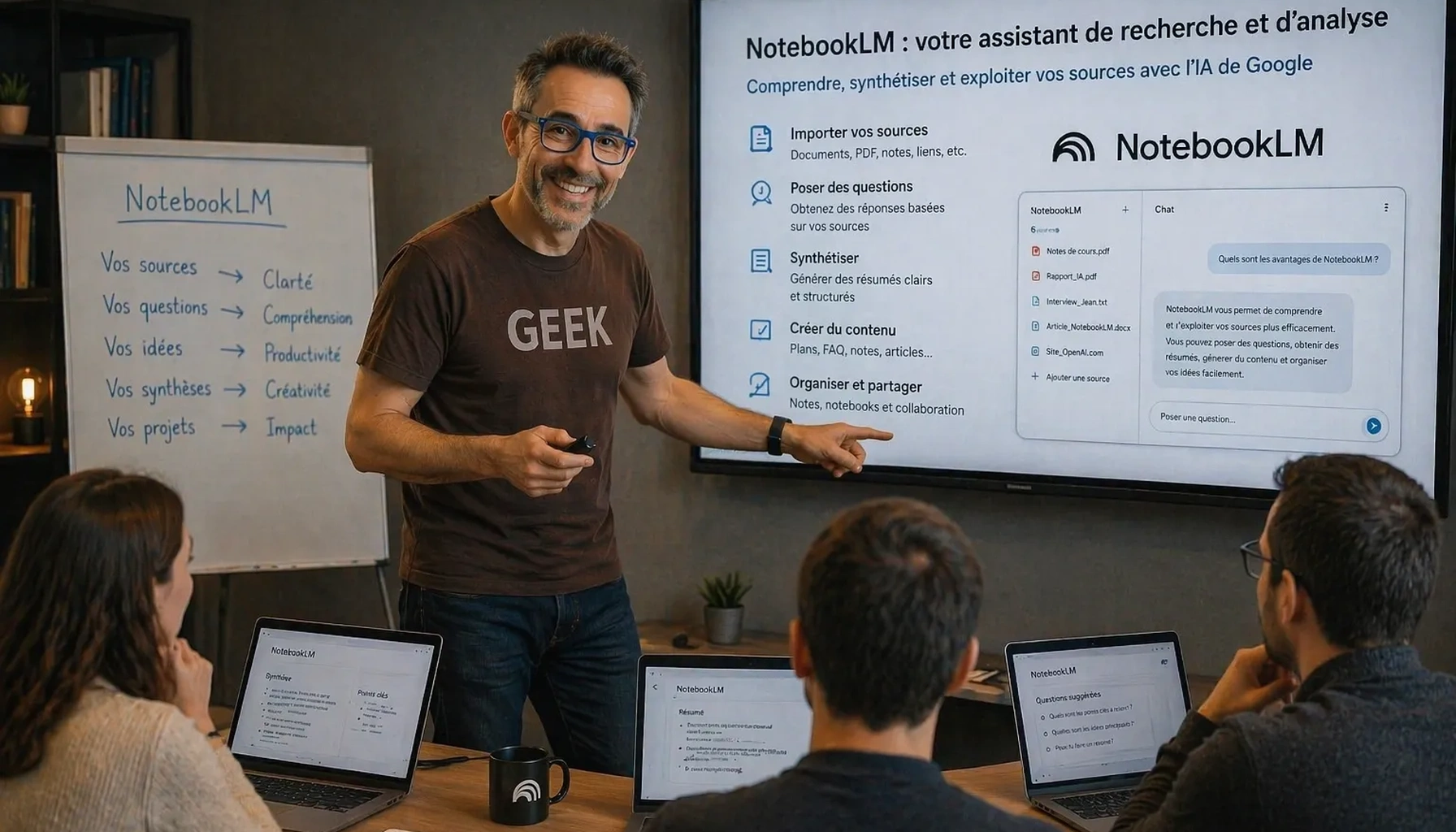

NotebookLM est l’outil d’intelligence artificielle de Google qui transforme vos documents en base de connaissances personnelle. Basé sur le principe du RAG, il répond à vos questions uniquement à partir des fichiers que vous lui partagez — PDF, vidéos YouTube, sites web, notes, Google Drive. Résumés audio, podcasts, cartes mentales, présentations : tout est généré à la demande avec source citée.

NotebookLM permet de récupérer 5 à 10 heures par semaine en déléguant l’analyse documentaire à l’IA, mais 9 utilisateurs sur 10 se contentent de générer un résumé et passent à côté de 80% de la valeur. Au-delà de l’outil, le Vibe-Coding (Cursor, Claude Code, Lovable) permet de créer vos propres outils métier sur-mesure quand NotebookLM montre ses limites. La vraie méthode pro tient en 3 étapes — Analyser, Auditer, Enrichir — et un prompt RCTF qui structure chaque sortie.

En bref

| Temps de configuration | 30 minutes pour un notebook pro |

| Outils requis | NotebookLM (gratuit), ChatGPT ou Claude (pour Deep Research croisée), Google Drive |

| Coût | 0 € (version gratuite) — 19,99 €/mois (version Plus avec fonctionnalités avancées) |

| Gain estimé | 5 à 10 heures récupérées par semaine |

| Niveau technique | Débutant à intermédiaire |

| Protocole/Stack | RAG · Google Gemini · Deep Research multi-IA · Prompts RCTF |

SOMMAIRE

- 1. NotebookLM, c’est quoi concrètement ?

- 2. L’interface en 3 zones : sources, chat, studio

- 3. Les 9 formats générés par le studio

- 4. Le piège n°1 : les biais et les lacunes de données

- 5. La méthode pro : Analyser, Auditer, Enrichir (3 prompts prêts à copier)

- 6. Le méga-prompt RCTF pour des sorties de qualité professionnelle

- 7. Ma stack Deep Research multi-IA pour neutraliser les biais

- 8. Cas d’usage concrets pour TPE/PME

“Pourquoi faire en quelques heures ce que vous pouvez faire en quelques minutes ?”

1. NotebookLM, c’est quoi concrètement ?

NotebookLM est l’outil d’IA proposé par Google qui vous laisse créer des « dossiers intelligents ». Vous y déposez vos sources — PDF, DOCX, PPTX, URLs web, vidéos YouTube, notes Google Docs — et l’IA répond à vos questions en s’appuyant exclusivement sur ce corpus. Pas de dérive, pas d’invention : si l’information n’est pas dans vos documents, elle vous le dit.

Techniquement, l’outil fonctionne sur le principe du RAG (Retrieval-Augmented Generation). C’est l’un des concepts IA fondamentaux à maîtriser en 2026 : plutôt que d’interroger la mémoire figée d’un LLM généraliste, on nourrit le modèle en temps réel avec un corpus contrôlé. Résultat : des réponses sourcées (chaque affirmation renvoie à la pastille du document d’origine) et zéro hallucination sur des faits qui sortent du corpus.

Pourquoi cet outil me sert tous les jours

Lors d’une formation que j’ai dispensée récemment à une PME nantaise du secteur logistique, j’ai fait l’exercice avec leur équipe : 6 rapports d’activité mensuels, un cahier des charges de 120 pages, deux audits externes, trois articles de presse. Temps qu’ils mettaient à extraire une synthèse pour le COMEX : environ 1 journée. Temps avec NotebookLM après configuration pro : 20 minutes. Le différentiel de ROI est énorme — et ce n’est pas anecdotique : selon Google, un cadre passe en moyenne 2 jours par semaine à chercher, lire, croiser et synthétiser des documents. Bien utilisé, l’outil vous en récupère l’essentiel.

Pour aller plus loin dans l’écosystème, j’ai déjà détaillé comment combiner NotebookLM avec Claude Code pour construire un véritable moteur de recherche interne, et comment générer des infographies pro directement depuis un notebook.

2. L’interface en 3 zones : sources, chat, studio

L’interface suit une logique en trois colonnes. La maîtriser en 5 minutes fait la différence entre un outil frustrant et un outil qui vous fait gagner une journée par semaine.

| Zone | Rôle | Actions principales |

|---|---|---|

| Sources (gauche) | Corpus du notebook | Importer (fichier, URL web, YouTube, Google Drive, texte collé) · Cocher/décocher pour filtrer · Lancer une Deep Research |

| Chat (centre) | Dialogue IA contextualisé | Poser des questions ouvertes · Obtenir des réponses sourcées (pastilles cliquables) · Affiner par relance |

| Studio (droite) | Générateur de formats | Résumé audio · Podcast · Présentation · Vidéo · Carte mentale · Rapport · Fiche · Quiz · Tableau · Infographie |

Les formats de source acceptés

L’outil avale quasiment tout : PDF, DOCX, TXT, MP3, MP4, images avec texte (OCR intégré), liens web, vidéos YouTube (la transcription est extraite automatiquement), fichiers Google Docs/Slides/Sheets via connexion Drive. La seule limite concrète : 200 Mo par fichier, ce qui peut coincer sur les vidéos longues. Astuce : pour une vidéo d’1 h, collez directement l’URL YouTube plutôt que d’uploader le MP4 — la transcription est récupérée automatiquement sans surcharger le notebook.

Le filtrage par cases à cocher

Chaque source cochée est incluse dans le contexte de la question. Décocher 20 des 25 sources d’un notebook permet de poser une question ciblée sur 5 documents précis sans polluer la réponse avec le reste du corpus. C’est l’une des fonctions les plus sous-exploitées : la majorité des utilisateurs laissent tout coché par défaut et se demandent pourquoi les réponses deviennent vagues quand le corpus grossit.

3. Les 9 formats générés par le studio

Le studio est le vrai différenciateur face à ChatGPT ou Claude. Vous cliquez, vous obtenez un livrable formaté, sourcé, prêt à diffuser. Voici l’inventaire complet avec mes cas d’usage clients concrets :

- Résumé audio — 4 formats au choix : approfondi, bref, critique des sources, débat. Idéal pour écouter la synthèse d’un dossier en voiture.

- Podcast conversationnel — Deux voix IA qui débattent du sujet pendant 12 à 20 minutes. Bluffant pour l’acculturation IA d’une équipe.

- Présentation slide — Diaporama structuré (détaillé ou mode présentateur). J’en utilise pour mes conférences clients après vérification manuelle.

- Résumé vidéo — Vidéo explicative avec narration et visuels. Plusieurs designs disponibles (tableau blanc, papier découpé, minimaliste).

- Carte mentale interactive — Arborescence cliquable qui relance une requête dans le chat à chaque nœud. Parfait pour explorer un corpus dense.

- Rapport écrit — Document structuré en sections, exportable. Utile comme brouillon sérieux à retravailler.

- Fiche de révision — Pour la formation, c’est un game-changer.

- Quiz — Questions à choix multiples sourcées. Je l’utilise pour auditer la compréhension de mes stagiaires en fin de formation.

- Tableau synthétique + Infographie — Comparaison tabulaire ou visuel partageable. Mon usage préféré pour les veilles concurrentielles.

Le piège : cliquer sur « Générer » sans prompt. Vous obtenez quelque chose d’honnête mais générique. La méthode micro-tasking que j’applique sur ChatGPT, Claude et Gemini se transpose ici : un prompt RCTF (détaillé en section 6) transforme une sortie moyenne en livrable exploitable.

“On ne demande pas à l’IA d’être intelligente. Juste d’être efficace.”

4. Le piège n°1 : les biais et les lacunes de données

Voici ce que 90% des tutoriels n’abordent jamais, et qui fait la différence entre un outil bluffant et un outil vraiment pro : NotebookLM hérite des biais de votre corpus. C’est le revers de la médaille du RAG. L’IA ne cherche pas de perspective contradictoire sur le web : elle répond avec ce que vous lui avez donné, point.

Si vous construisez un notebook sur « l’IA dans les TPE » en n’y déposant que des articles pro-IA écrits par des vendeurs d’outils, vous obtiendrez des réponses enthousiastes, unilatérales, et factuellement cohérentes avec vos sources. Le problème : elles sont biaisées par construction. Et comme la présentation est impeccable (sources citées, ton professionnel, chiffres), on leur fait confiance.

Les 3 types de lacunes qui cassent votre notebook

- Lacune méthodologique — Vous parlez d’un protocole (fine-tuning, RAG, déploiement) sans jamais décrire le « comment » opérationnel.

- Lacune contre-argumentative — Vos sources sont toutes d’accord. Aucune opposition, aucun risque documenté. La nuance est absente.

- Lacune quantitative — Vous avez des concepts mais aucune donnée chiffrée pour arbitrer (coûts, durées, volumes, taux d’adoption).

Tant que vous n’avez pas identifié ces lacunes, toutes les sorties du studio (podcast, slides, rapport) seront biaisées dans la même direction que votre corpus. D’où la méthode qui suit.

5. La méthode pro : Analyser, Auditer, Enrichir (3 prompts prêts à copier)

La règle d’or que j’applique sur chaque notebook, et que je transmets dans mes formations : avant d’utiliser le studio, auditez votre corpus. Trois prompts, trois minutes, et votre notebook monte de deux niveaux en qualité. Copiez-collez-les dans la zone de chat après avoir cochez toutes vos sources.

Prompt 1 — Analyser les points forts

Liste :

1. Les hypothèses les plus solides et bien documentées (données, études, citations)

2. Les angles thématiques couverts avec profondeur

3. Les 3 objectifs métier qu’on peut atteindre avec le corpus actuel

Pour chaque point, cite la source (numéro de pastille).

Réponds en 10 bullet points concis, structurés en 3 sections.

Prompt 2 — Auditer les lacunes

Pour chaque gap identifié :

– Catégorie : méthodologique / contre-argumentative / quantitative / temporelle / sectorielle / réglementaire / opérationnelle

– Gravité : CRITIQUE / MODÉRÉ / MINEUR

– Description en 1 phrase

– Impact sur la fiabilité des sorties du studio

À la fin, propose une synthèse : quelles sorties du studio sont actuellement fiables, lesquelles sont à risque.

Sois sévère : mieux vaut un audit dur qu’un livrable bancal.

Prompt 3 — Enrichir le corpus

– La fonction « Recherche approfondie » de Notebook

– ChatGPT Deep Research

– Claude ou Perplexity

Chaque requête doit :

1. Cibler un gap prioritaire (CRITIQUE en premier)

2. Être formulée en langage naturel (pas en mots-clés Google)

3. Préciser le format de sortie attendu (liste, tableau, synthèse critique)

4. Indiquer 2-3 types de sources à privilégier (études, rapports officiels, retours terrain)

Présente les 5 requêtes numérotées, avec le gap visé en titre.

Vous lancez les 5 requêtes en parallèle sur trois moteurs de recherche IA, vous récupérez les rapports PDF, vous les réimportez dans NotebookLM. Le corpus passe de 10 documents biaisés à 15-20 documents multi-sources, multi-angles. C’est seulement à ce moment-là que le studio produit des livrables de qualité pro.

6. Le méga-prompt RCTF pour des sorties de qualité professionnelle

Une fois le corpus audité et enrichi, vous passez au studio. Et là, deuxième erreur classique : cliquer « Générer » sans prompt. Le résultat sera honnête, mais jamais à la hauteur.

La structure que j’applique systématiquement est le RCTF — Rôle, Contexte, Tâche, Format. Quatre blocs, chacun avec un objectif précis. Voici le méga-prompt complet, à adapter en fonction du format visé (présentation, podcast, rapport, fiche) :

Tu es un [expert métier — ex: consultant en stratégie digitale, formateur senior en cybersécurité, data analyst financier] avec 15 ans d’expérience. Tu es reconnu pour ta capacité à vulgariser des concepts complexes sans les simplifier. Tu parles en première personne, tu donnes des exemples concrets, tu cites tes sources.

**CONTEXTE**

Ce notebook contient [N] documents sur [thématique précise].

Mon objectif : [objectif métier précis — ex: préparer un COMEX de 45 min sur la stratégie IA, former une équipe de 8 commerciaux à la prospection augmentée, produire un livre blanc de 15 pages pour un prospect stratégique].

Mon audience : [audience type + niveau technique].

Les 3 messages clés que je veux faire passer : [message 1, message 2, message 3].

**TÂCHE**

Génère [format cible : présentation / podcast / rapport / fiche] en te basant EXCLUSIVEMENT sur les sources cochées.

Structure attendue :

1. [Section 1 — angle + objectif]

2. [Section 2]

3. [Section 3]

4. [Conclusion + recommandations opérationnelles]

Contraintes :

– Chaque affirmation doit citer sa source (pastille NotebookLM)

– Si une donnée manque, le signaler explicitement : « Source à croiser »

– Ton : [professionnel / accessible / technique / vulgarisé]

– Éviter [anti-patterns : jargon excessif, tournures corporate, conditionnel mou]

**FORMAT**

– Format de sortie : [slide 16:9 paysage / audio conversationnel 12 min / rapport Word 8 pages]

– Longueur : [X slides / Y minutes / Z pages]

– Structure : [titre + sommaire + N parties + conclusion + FAQ optionnelle]

– Livrables additionnels : [notes de présentateur, résumé exécutif, liste d’actions]

Le principe du RCTF, c’est que chaque bloc réduit l’espace des réponses possibles de l’IA. Sans rôle, l’IA adopte un ton générique. Sans contexte métier, elle reste théorique. Sans tâche précise, elle produit un résumé. Sans format, elle livre un bloc de texte. Les quatre ensemble forcent un livrable ciblé, ce qui économise aussi des tokens.

7. Ma stack Deep Research multi-IA pour neutraliser les biais

La fonction Deep Research intégrée est excellente, mais elle reste biaisée par un paramètre invisible : le biais propre du modèle Gemini. Chaque LLM a ses inclinations — Gemini tire vers le consensus, ChatGPT vers l’exhaustivité, Claude vers la nuance argumentative. C’est pour ça que j’utilise systématiquement au moins trois IA différentes pour les recherches stratégiques.

| Moteur Deep Research | Force principale | Biais à compenser | Quand je l’utilise |

|---|---|---|---|

| NotebookLM (Gemini) | Structuration rigoureuse, sources académiques | Consensus, évite la nuance politique | Sujets techniques, réglementaires |

| ChatGPT Deep Research | Profondeur, exhaustivité, synthèse longue | Tend à aplanir les controverses | Études de marché, benchmarks |

| Claude | Raisonnement nuancé, contradicteur intégré | Plus prudent, livre moins de contenu brut | Analyses stratégiques, débats |

| Perplexity | Temps réel, actualité, sources fraîches | Moins de structure longue | Veille, sujets d’actualité |

Ma routine concrète : la même requête envoyée aux quatre moteurs, les 4 rapports PDF importés dans le notebook, puis un prompt « Identifie les convergences et divergences entre ces 4 rapports » dans le chat. Les divergences révèlent les angles contestés. Les convergences constituent le socle fiable du livrable. C’est la seule méthode que je connaisse pour produire un contenu IA qui tient la route face à un audit critique.

Quand l’outil ne suffit plus : créer le vôtre

NotebookLM excelle sur la lecture/synthèse documentaire, mais montre ses limites dès qu’il faut croiser plusieurs dossiers, automatiser un flux, ou exposer l’IA à des utilisateurs finaux non-techniques. Pour ces cas, je bascule sur du Vibe-Coding — Cursor, Claude Code, Lovable — et je livre en 3 à 5 jours un outil sur-mesure pour la PME (base de connaissances interne, moteur de recherche métier, assistant IA spécialisé). C’est la logique que j’applique aussi sur d’autres workflows, comme les Skills Claude pour automatiser les tâches métier ou Claude Routines pour un stagiaire IA qui tourne 24/7.

“L’IA ne va pas remplacer les humains mais les humains qui utilisent l’IA vont remplacer ceux qui ne l’utilisent pas.”

8. Cas d’usage concrets pour TPE/PME

La théorie, c’est bien, mais ce qui compte en TPE/PME, c’est le ROI opérationnel. Voici les 5 cas d’usage que j’installe chez mes clients, avec gain estimé en heures par semaine :

- Dossiers d’appel d’offres — Déposer le cahier des charges, les 3 derniers AO gagnés et perdus, et les retours client. Prompt : « Produis le plan de réponse type avec les arguments différenciants. » Gain : 4-6 h par réponse.

- Veille concurrentielle mensuelle — URLs des sites de 5 concurrents + articles presse du mois + rapports sectoriels. Prompt : « Tableau comparatif offres/prix/positionnement + podcast 10 min sur les évolutions du mois. » Gain : 1 journée/mois.

- Onboarding nouveaux salariés — Tous les documents internes (process, guides outils, organigrammes). Prompt : « Quiz de 20 questions pour valider la montée en compétence après 2 semaines. » Gain : le formateur n’écrit plus le quiz à la main.

- Réponses aux questions fournisseurs — Contrats types, historique d’échanges, CGV. Prompt : « Qu’avons-nous déjà répondu à ce fournisseur sur [sujet] ? » Gain : 2-3 h/semaine au service achats.

- Synthèses de réunions stratégiques — Importer l’enregistrement vidéo ou audio de la réunion. Prompt : « Liste des décisions prises, actions assignées, points en suspens. » Gain : le compte-rendu rédigé en 5 minutes au lieu de 1 h.

Le dénominateur commun : à chaque fois, ce sont des tâches documentaires récurrentes, à faible valeur ajoutée individuelle mais à fort cumul horaire. Exactement ce que mon approche d’acculturation IA en PME vise à déléguer en priorité.

Questions fréquemment posées

NotebookLM est-il vraiment gratuit ?

Oui, dans sa version standard, à condition d’avoir un compte Google. La version gratuite suffit pour 95% des usages TPE/PME : jusqu’à 100 notebooks, 300 sources par notebook, tous les formats du studio. La version NotebookLM Plus (19,99 €/mois, incluse dans Google One AI Premium) débloque des quotas plus élevés et certaines fonctionnalités pro. Pour tester la méthode de cet article, la version gratuite suffit largement.

Mes données sont-elles sécurisées dans NotebookLM ?

Google indique que les sources uploadées dans NotebookLM ne sont pas utilisées pour entraîner ses modèles d’IA généralistes. C’est un gage important pour les entreprises. Attention cependant : pour des documents vraiment sensibles (données RH, secrets commerciaux, données de santé), je recommande Google Workspace avec les contrôles DLP activés, ou la mise en place d’un RAG privé sur votre propre infrastructure. Pour les PME sans contrainte de conformité stricte, NotebookLM standard est largement suffisant.

Quelle différence entre NotebookLM et ChatGPT avec recherche dans les fichiers ?

NotebookLM est conçu autour du RAG avec sources persistantes et sourçage systématique ; ChatGPT est conçu pour le dialogue généraliste. Concrètement, NotebookLM refuse d’inventer ce qui n’est pas dans vos sources (chaque réponse cite la pastille d’origine), ce qui en fait un outil fiable pour l’analyse documentaire. ChatGPT avec GPTs ou projets offre des fonctionnalités voisines mais tend à combler les lacunes avec sa connaissance pré-entraînée — plus flexible, moins sourcé.

Combien de sources peut-on mettre dans un notebook ?

Jusqu’à 300 sources dans un notebook standard, avec une limite de 200 Mo par fichier. En pratique, au-delà de 50 sources, la qualité du chat baisse si vous laissez tout coché. Mon conseil pro : un notebook = un projet = 20 à 40 sources maximum, et utilisez le filtrage par case à cocher pour focaliser vos requêtes sur les 5-10 sources pertinentes selon la question.

Peut-on utiliser NotebookLM en équipe ?

Oui, les notebooks se partagent comme un document Google Drive, avec droits de lecture ou d’édition. C’est l’un des usages les plus sous-exploités en PME : créer un notebook d’équipe « Connaissance commerciale » ou « Onboarding RH », tous les collaborateurs y accèdent et peuvent interroger l’IA sur le corpus partagé. La version Plus permet des fonctionnalités de collaboration renforcées, mais le partage basique fonctionne en version gratuite.

Pourquoi choisir un formateur IA à Nantes ou en Pays de la Loire pour déployer NotebookLM ?

Parce qu’un outil comme NotebookLM prend sa vraie valeur quand il est configuré sur vos documents, vos process et vos cas d’usage métier — pas en formation théorique à distance. En tant qu’expert basé à Nantes, j’interviens directement dans vos locaux en Pays de la Loire pour auditer vos vrais corpus documentaires, installer vos notebooks types avec vos équipes et coder sur place les automatisations périphériques (import documents, push Slack/Teams des synthèses, exports vers vos outils métier). L’accompagnement de proximité, les formations certifiées Qualiopi et le suivi post-formation font la différence entre un outil installé et un outil réellement adopté.

Christophe Girard

Consultant IA, Formateur & Créateur de Micro-SaaS — Fondateur d’ATLANTICOM

Basé en région nantaise, je crée des logiciels sur mesure et des Micro-SaaS pour les TPE/PME grâce au Vibe-Coding (Cursor, Claude Code, Bolt.new).

Formations certifiées Qualiopi, audits IA, automatisations et outils internes sur-mesure :

je vous aide à remplacer vos fichiers Excel par de vrais outils métier — en jours, pas en mois.

Audit IA

Automatisations

Micro-SaaS

“Avec l’IA, le futur, c’est maintenant !”

— ATLANTICOM